决策树

决策树学习的算法通常是一个递归地选择最优特征,并根据该特征对训练数据进行分割,使得对各个子数据集有一个最好的分类的过程。

一、决策树

单树作为所有集成树的基数,主要有三种:

1.ID3 (分类树)

2.C4.5(分类树)

3.CART(回归树)

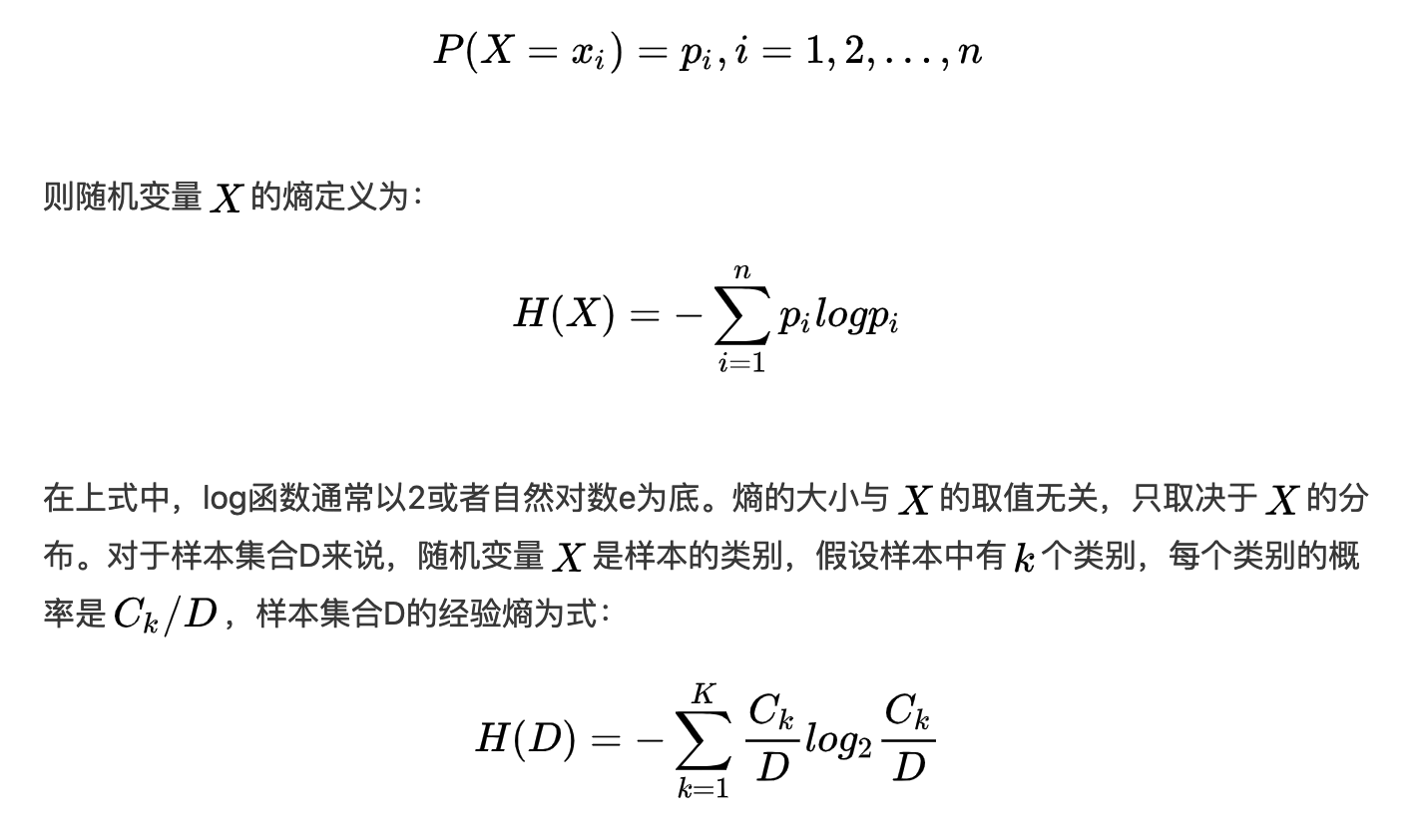

二、熵

熵(Entropy)是一个热力学概念,在信息论中,熵用来衡量随机变量的不确定性。一个系统越有序,熵越小;越混乱,熵越大。因此熵用来衡量一个系统的有序程度。在机器学习的的过程中,变量的不确定越大,熵越大。设是一个取有限个值的离散随机变量,其概率分布为:

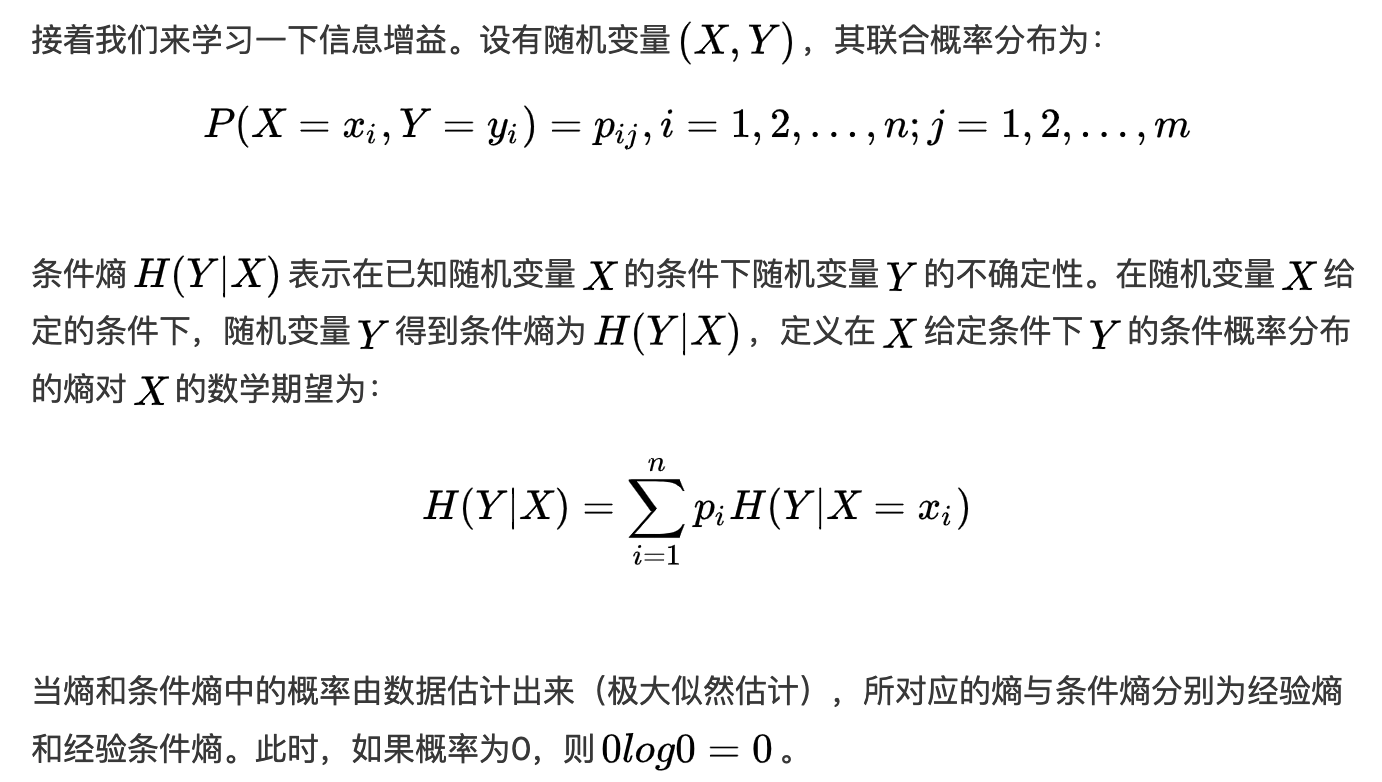

三、条件熵

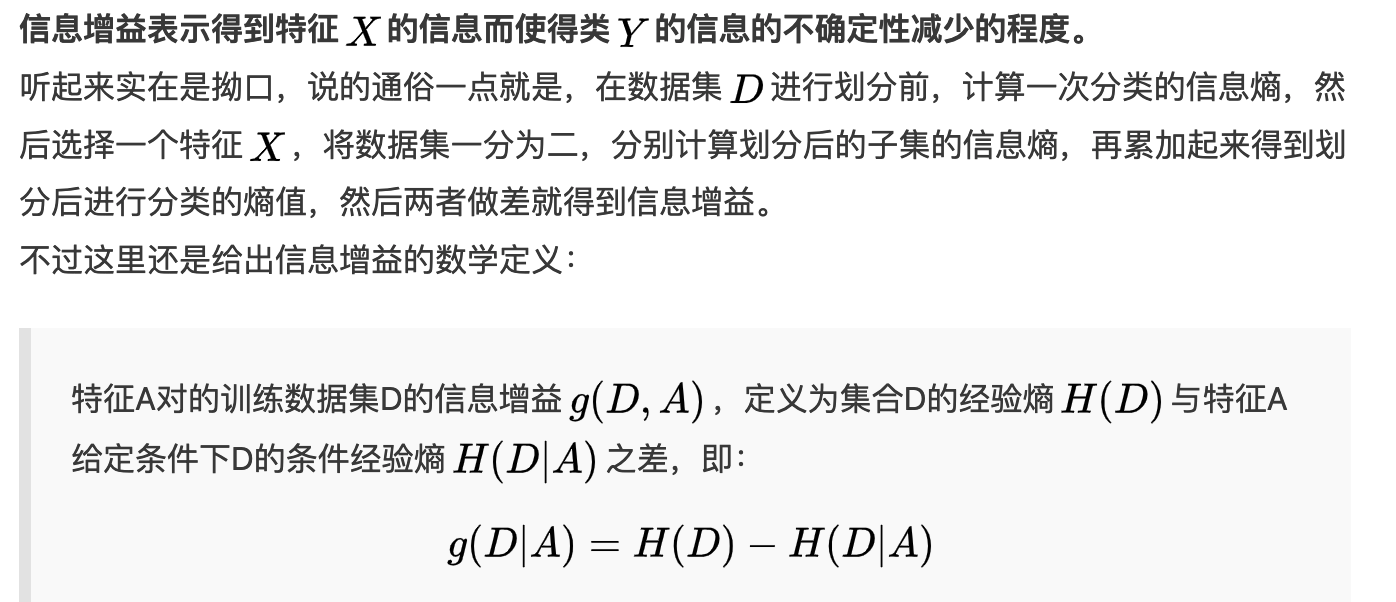

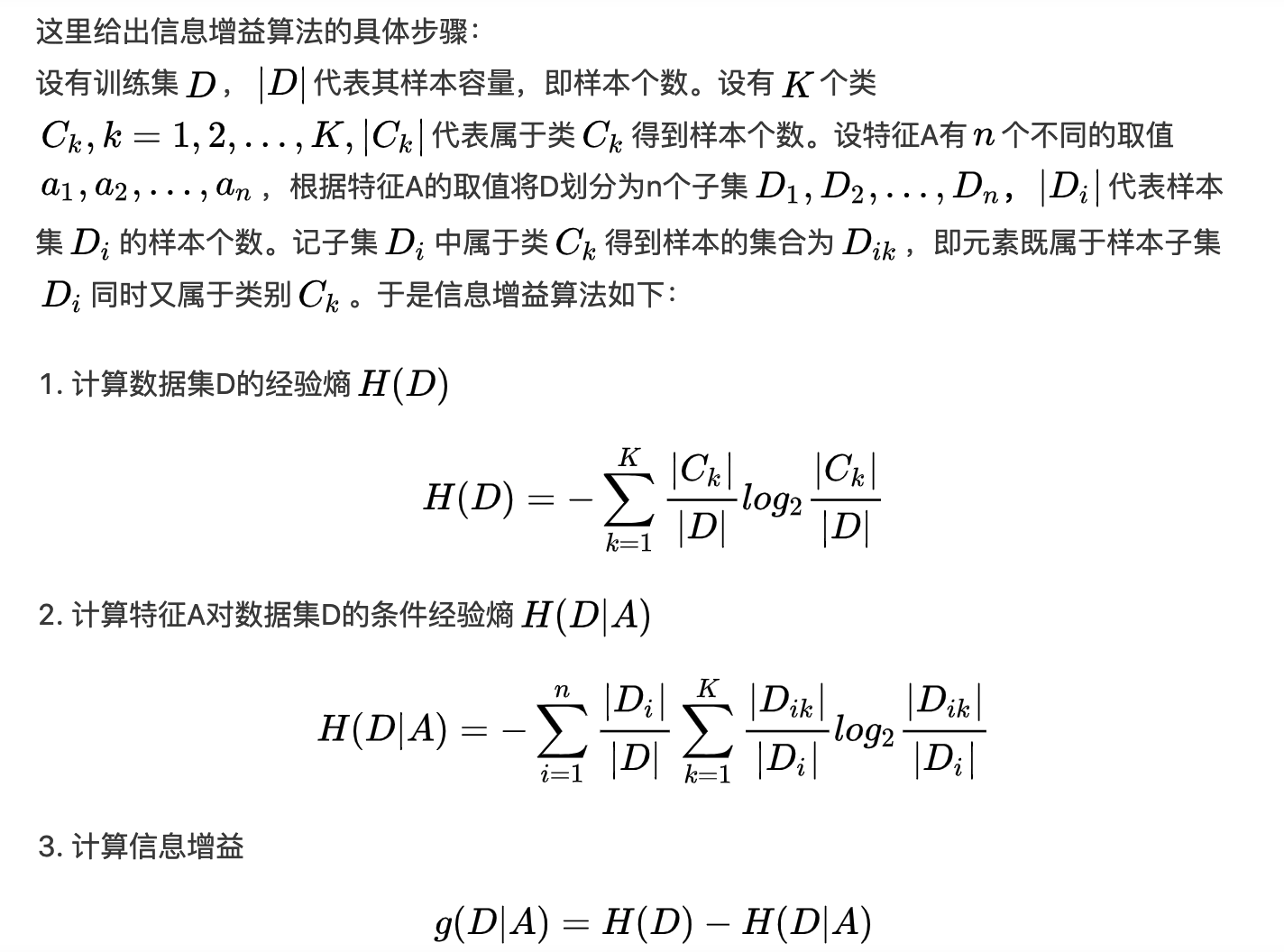

四、信息增益---ID3算法

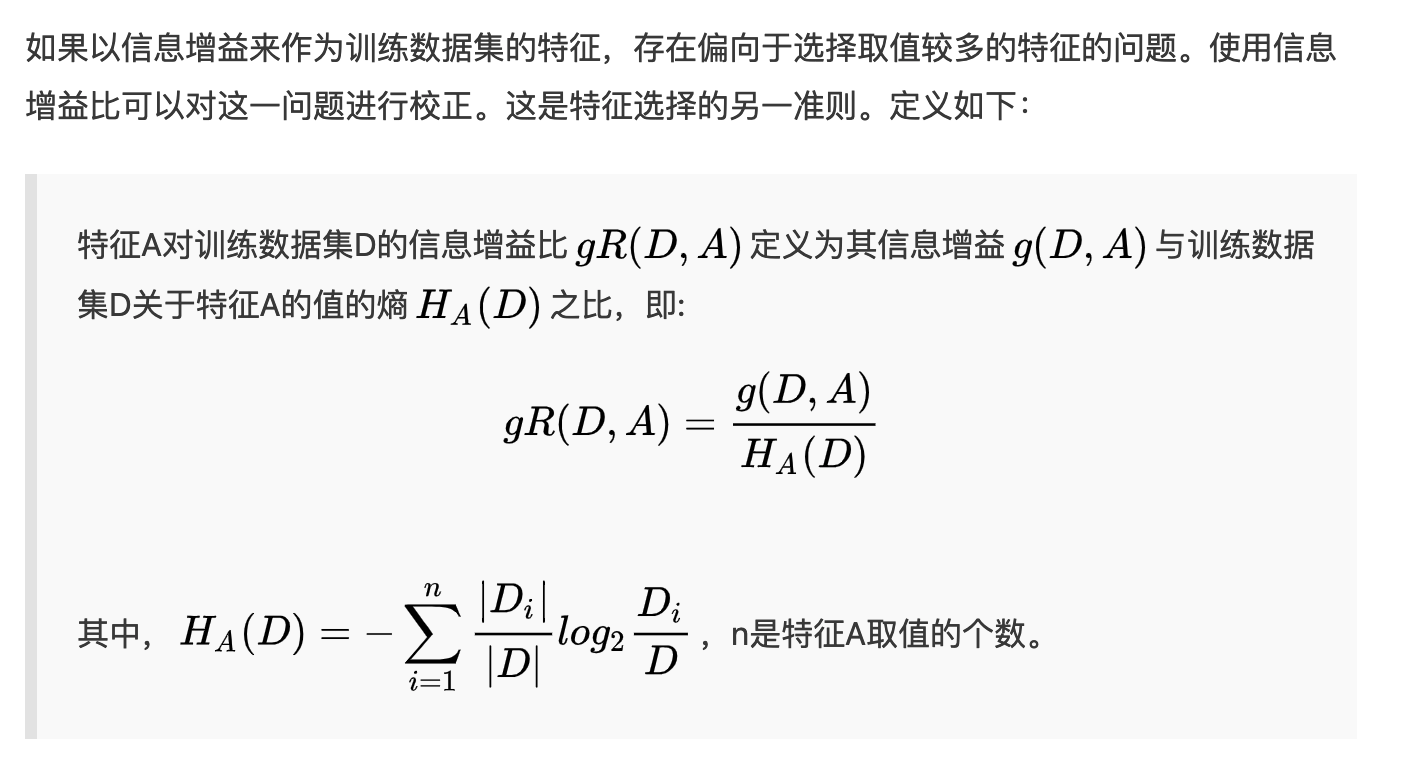

五、信息增益比----C4.5

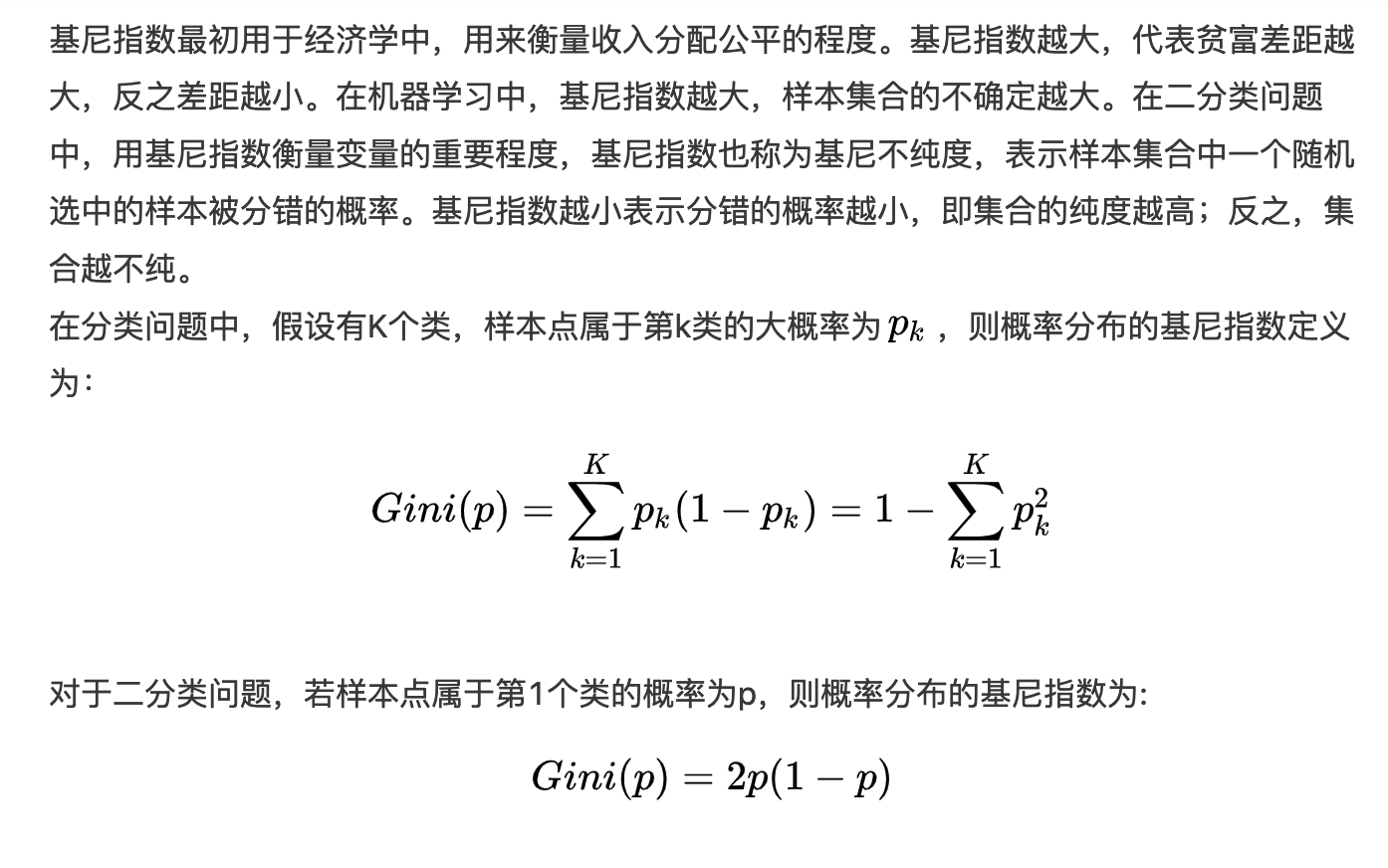

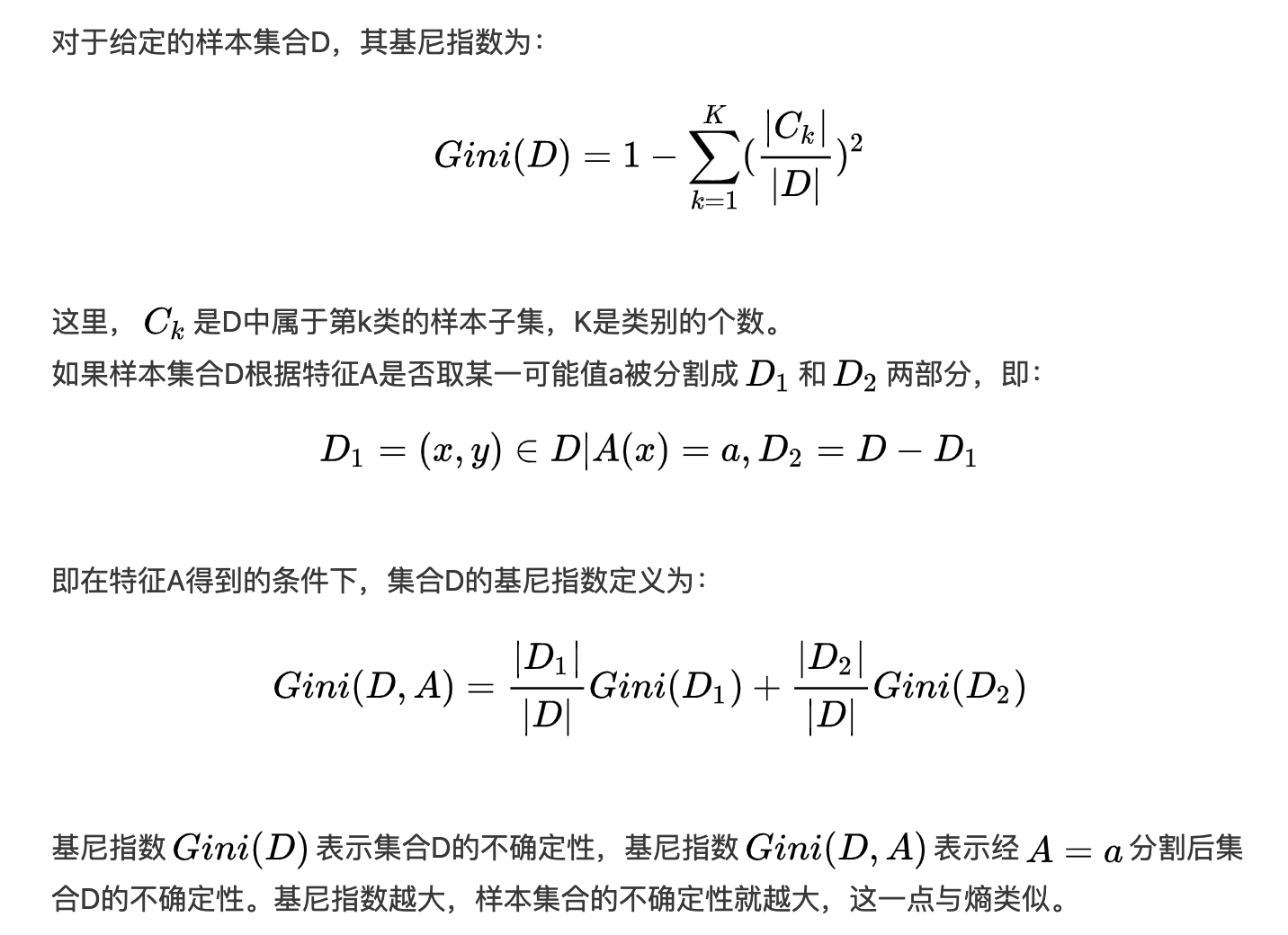

六、基尼指数----CART